理解AI语言训练模型的基本原理

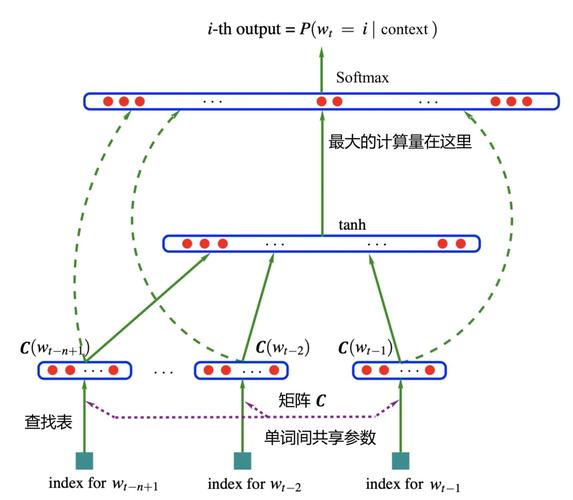

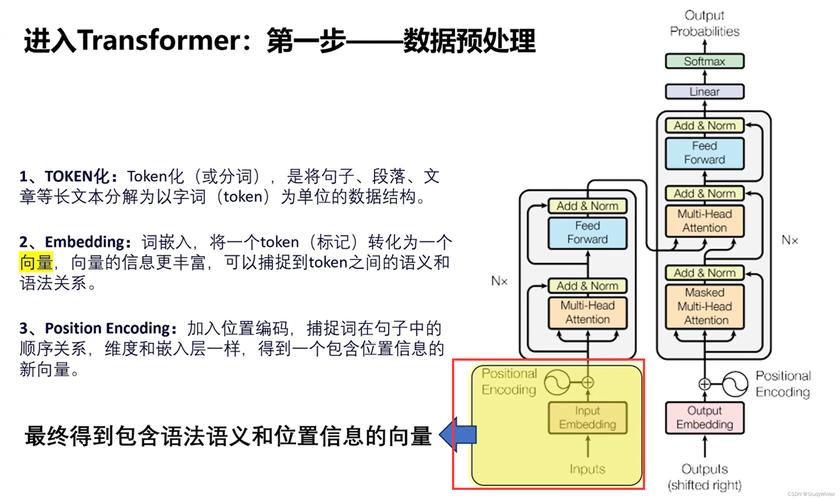

AI语言训练模型是近年来人工智能领域的重大突破,其核心是通过大量数据学习语言规律,从而生成符合人类表达习惯的文本,这类模型的训练过程通常分为两个阶段:预训练与微调,预训练阶段,模型通过海量文本学习词汇、语法和语义关联;微调阶段,则针对特定任务(如问答、翻译)进行优化,理解这一原理,是正确使用语言模型的前提。

常见应用场景与使用步骤

AI语言模型的应用场景广泛,从内容生成到客户服务均可覆盖,以下是几种典型场景及对应的使用方法:

创作辅助**

- 需求分析:明确需要生成的内容类型(如文章、广告文案)及目标受众。

- 输入指令:向模型提供清晰、具体的提示(Prompt),撰写一篇关于环保的科普文章,面向青少年群体”。

- 结果优化:根据生成内容调整关键词、语气或结构,确保符合品牌调性。

-

客户服务自动化

- 构建知识库:将常见问题与标准答案整理为结构化数据。

- 训练模型:使用微调技术让模型熟悉业务场景的特定表达。

- 部署与测试:通过对话模拟验证回答准确性,逐步优化响应逻辑。

-

数据分析与摘要

- 数据输入:上传需要分析的文本或报告。

- 提取关键信息:通过指令要求模型总结核心观点或统计高频词汇。

- 生成可视化建议:结合结果设计图表或流程图,提升信息传达效率。

提升使用效果的关键技巧

-

精准设计提示词(Prompt Engineering)

模型输出质量高度依赖输入的提示词,避免模糊指令,尽量细化需求,将“写一篇科技文章”改为“撰写一篇面向初创企业的技术趋势分析,重点涵盖2023年人工智能在制造业的应用案例”。

-

结合人工审核机制

尽管AI生成效率高,但内容仍需人工校验,尤其是涉及专业领域或敏感信息时,建议建立“生成-审核-修正”的流程闭环,平衡效率与准确性。 -

持续迭代训练数据

若模型应用于垂直领域(如医疗、法律),需定期更新训练数据,纳入行业最新术语与政策变化,防止信息过时导致错误。

需警惕的潜在风险

-

信息真实性存疑

语言模型可能生成看似合理但实际错误的内容,在回答历史事件时,可能出现时间线混淆,用户需对关键信息进行交叉验证。 -

伦理与版权问题

直接复制模型生成的文本可能存在版权风险,建议对内容进行二次创作,或使用具备合规训练数据的开源模型(如Llama 2、Bloom)。 -

过度依赖导致能力退化

长期依赖AI完成写作、决策等工作,可能削弱人类的独立思考能力,合理做法是将其定位为“辅助工具”,而非完全替代人工。

个人观点

AI语言模型的价值在于放大人类创造力,而非取代它,设计师可用其快速生成文案初稿,再将精力集中于创意优化;教师可通过模型生成习题,但需根据学生反馈调整难度,技术本身无好坏之分,关键在于使用者是否建立清晰的边界——在效率与伦理、自动化与人性化之间找到平衡点,随着多模态模型的发展,语言训练技术的应用场景将进一步扩展,但核心逻辑不会改变:人的判断力,始终是技术落地的最终防线。