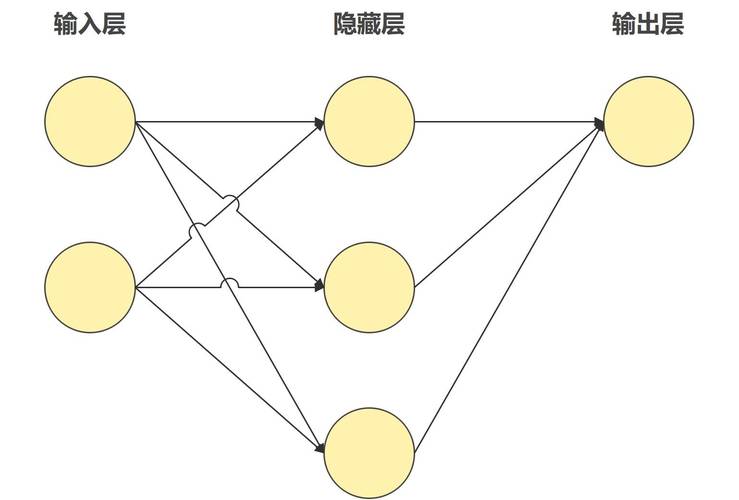

理解AI绘画模型链接的核心作用

AI绘画模型链接通常指向预训练模型文件的下载地址,或直接关联到在线调用接口,这些模型由开发者通过大量数据训练而成,能够根据输入的文字或图像生成新的视觉内容,Stable Diffusion、DALL-E等知名模型,均需通过特定链接获取模型文件或访问权限。

模型链接的准确性直接影响创作效果,错误的链接可能导致模型版本不匹配、功能缺失,甚至安全隐患,用户需优先选择官方渠道或可信的开源平台(如GitHub、Hugging Face)获取链接,避免通过非正规途径下载。

模型链接的获取与验证

官方渠道优先

大多数主流AI绘画工具提供明确的模型下载入口,以Stable Diffusion为例,其官网或开发者社区会发布更新日志及对应的模型版本链接,用户可通过订阅官方公告或关注开发者社交媒体账号,第一时间获取最新资源。

开源社区筛选

开源平台汇聚了大量开发者共享的模型,但质量参差不齐,建议查看模型的“星标数”(Star)、用户评论及更新频率,高活跃度的项目通常更可靠,Hugging Face平台上的模型会标注训练数据集、适用场景及使用协议,方便用户评估。验证文件安全性

下载前,务必检查文件格式与大小,常见的模型格式为.ckpt、.safetensors或.pt,若链接提供的是压缩包,需警惕内含非相关文件,部分平台提供MD5或SHA256校验码,用户可通过比对确保文件未被篡改。

本地部署与云端调用的操作指南

本地部署:适合技术型创作者

环境配置

本地运行需安装Python、PyTorch等依赖库,并确保硬件支持(如NVIDIA显卡适配CUDA),以Stable Diffusion为例,用户需从GitHub克隆代码仓库后,将下载的模型文件放入指定文件夹(如models/stable-diffusion-v1-5)。启动与调试

通过命令行工具运行脚本时,需指定模型路径,若出现显存不足报错,可调整生成图片的分辨率或启用内存优化参数,社区论坛(如Reddit的r/StableDiffusion板块)常有技术贴分享调试经验。

云端调用:零基础用户的快捷选择

许多平台提供在线服务,用户仅需将模型链接粘贴至对应接口即可调用,Replicate平台支持上传模型链接后,通过API生成图像,这种方式无需本地硬件资源,但可能产生费用,需注意平台的计费规则。

常见问题与解决方案

链接失效或下载中断

部分模型因版权问题可能被临时下架,遇到此类情况,可尝试在开源社区搜索同名替代模型,或联系链接发布者确认更新计划。模型与工具版本不兼容

若运行时报错“模型架构不匹配”,需检查代码库是否支持该模型版本,Stable Diffusion 2.0的模型需搭配v2.0以上的代码库运行。生成效果不理想

模型的表现受训练数据影响,若生成图片风格偏离预期,可尝试更换不同训练集的模型,或调整提示词(Prompt)的精确度,添加“8K分辨率”“梵高风格”等细节描述能显著改善输出质量。

版权与伦理规范需重视

AI绘画模型的训练数据可能包含受版权保护的内容,商用前,务必确认模型的使用协议:部分模型明确要求署名原作者,或禁止用于盈利场景,避免生成涉及暴力、歧视等违反伦理的内容,部分平台会通过内容过滤器屏蔽违规请求。

个人观点:技术与创意的平衡之道

AI绘画模型的便捷性降低了艺术创作的门槛,但工具的价值最终取决于使用者,熟练掌握模型链接的调用方法只是起点,如何将技术能力与个人审美结合,才是突破同质化作品的关键,建议创作者多尝试不同模型,从对比中理解其特性,同时保持对传统艺术技法的学习——毕竟,AI是画笔,而手握画笔的人,才是灵魂。