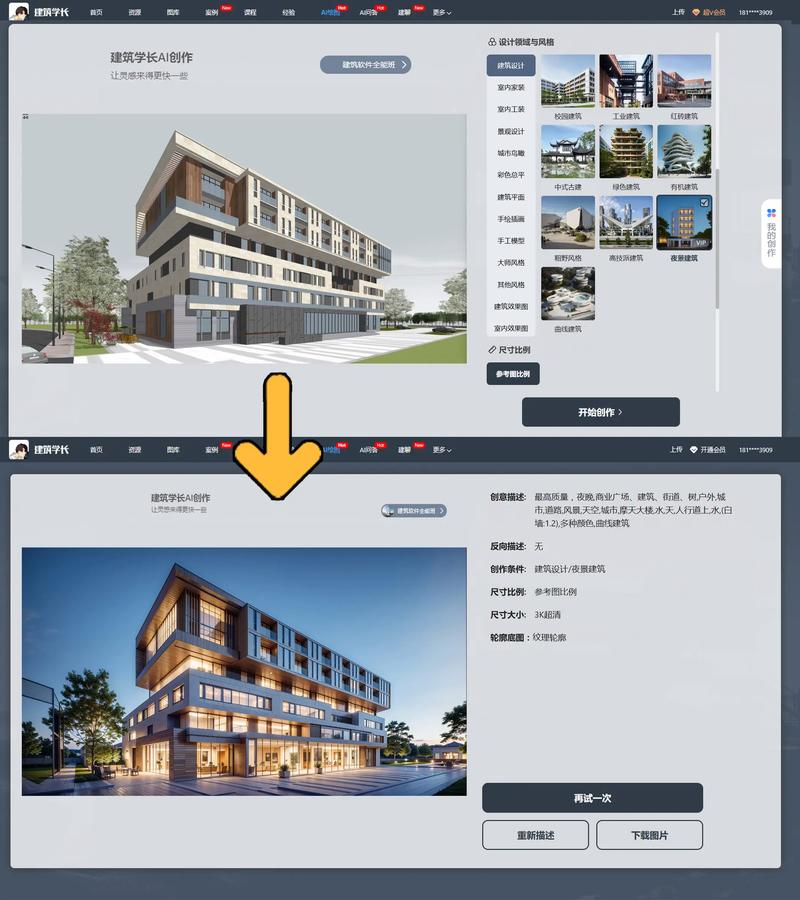

了解AI绘图模型的核心功能

AI绘图模型基于深度学习算法,能够根据文字描述或参考图生成图像,常见类型包括文生图模型(如Stable Diffusion)、图生图模型(如ControlNet),以及风格迁移类工具,不同模型针对不同需求:文生图适合从零开始创作;图生图适合优化现有作品;风格迁移则能快速匹配特定艺术效果,理解模型特性是选择合适工具的第一步。

下载前的必要准备

-

硬件配置检查

AI绘图对设备性能有一定要求,以Stable Diffusion为例,建议电脑配备NVIDIA显卡(显存至少4GB)、8GB以上内存,并预留20GB硬盘空间运行模型,若硬件不足,可考虑使用云端平台或简化版模型。

-

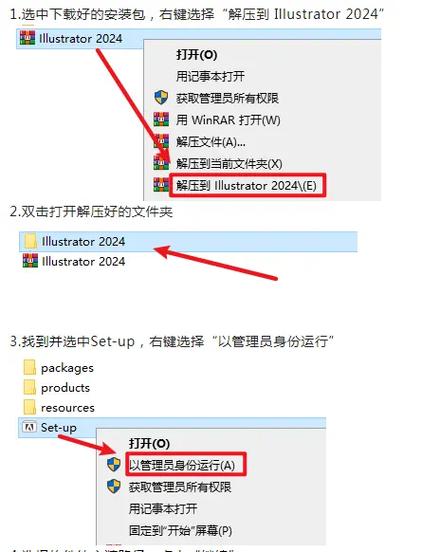

软件环境搭建

部分模型需依赖Python、PyTorch等开发框架,本地部署Stable Diffusion需安装Python 3.10+版本,并通过代码库管理工具Git克隆项目文件,非技术用户可选择整合包(如秋叶启动器),一键安装省去配置烦恼。 -

模型文件格式识别

主流模型格式包括.ckpt(检查点文件)、.safetensors(安全张量格式)及.pt(PyTorch权重文件),下载时需确认文件完整性,避免因版本冲突导致运行失败。

选择可信的模型下载渠道

AI模型的安全性直接影响使用体验,建议通过以下途径获取资源:

- 官方平台:如Hugging Face、Civitai等开源社区,提供经过审核的模型及使用文档;

- 开发者认证渠道:关注模型创作者在GitHub、社交媒体发布的更新动态;

- 用户社群推荐:参与Discord、Reddit等论坛讨论,获取已验证的高质量模型。

需警惕第三方网站提供的“破解版”或“免费商用模型”,此类文件可能携带恶意代码或侵权风险。

模型部署与基础操作指南

以Stable Diffusion WebUI为例,典型使用流程如下:

-

加载模型

将下载的.ckpt或.safetensors文件放入软件根目录的models/Stable-diffusion文件夹,重启WebUI即可在界面顶部选择模型。 -

参数设置

- 提示词(Prompt):描述画面主体、风格及细节,赛博朋克风格的城市夜景,霓虹灯光,雨雾效果,8K超清”;

- 反向提示词(Negative Prompt):排除不想要的元素,如“模糊、变形、水印”;

- 采样步数:通常20-30步可平衡质量与速度;

- 分辨率:建议初次尝试512x512,过高可能导致显存不足。

-

生成与优化

点击生成后,若效果不理想,可调整提示词权重(如(关键词:1.5)增强重要性),或使用LoRA、Hypernetwork等微调模型优化局部细节。

提升出图质量的实用技巧

-

关键词结构化

将提示词按“主体+环境+风格+画质”分类,“一只戴着礼帽的狐狸,站在蒸汽朋克风格的钟楼顶端,黄昏光线,油画质感,锐化细节”。 -

控制随机性

固定随机种子(Seed值)可复现相似结果,微调去噪强度(Denoising Strength)能调整生成图与原图的差异度。 -

分层处理

使用Inpainting功能局部重绘:先生成基础画面,再对特定区域(如面部、手部)单独优化,避免全局调整导致的资源浪费。

常见问题与风险规避

- 显存不足报错:降低分辨率、启用低显存模式(如

--medvram参数),或使用CPU渲染(速度较慢); - 版权争议:商用前确认模型许可协议,部分模型明确禁止训练数据包含版权作品;

- 失控过滤器(如NSFW屏蔽),避免产出违规图像。