人工智能语言模型近年来成为技术领域的热门话题,从日常对话到专业文本生成,这类模型展现出接近人类的表达能力,要理解其运作原理,核心在于掌握训练过程中的关键环节与技术逻辑。

数据是构建语言模型的基石,训练前需要收集涵盖多领域、多场景的文本数据,包括书籍、新闻、学术论文、社交媒体内容等,数据总量通常达到TB级别,覆盖数十种语言,专业团队会对原始数据进行多轮清洗,剔除重复信息与低质量内容,确保语料库的准确性与多样性,预处理阶段通过分词技术将文本转化为计算机可识别的标记序列,同时建立词汇表与语义关系图谱。

模型架构设计直接影响最终性能,当前主流采用Transformer结构,这种基于自注意力机制的神经网络能有效捕捉长距离语义关系,工程师会设计不同规模的模型参数,从数百万到数千亿不等,参数量的增加能提升模型对复杂语义的理解能力,但同时也带来计算资源消耗的指数级增长。

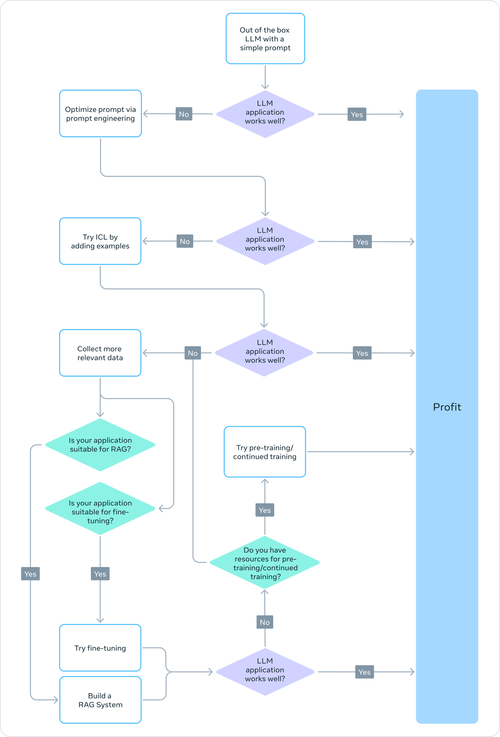

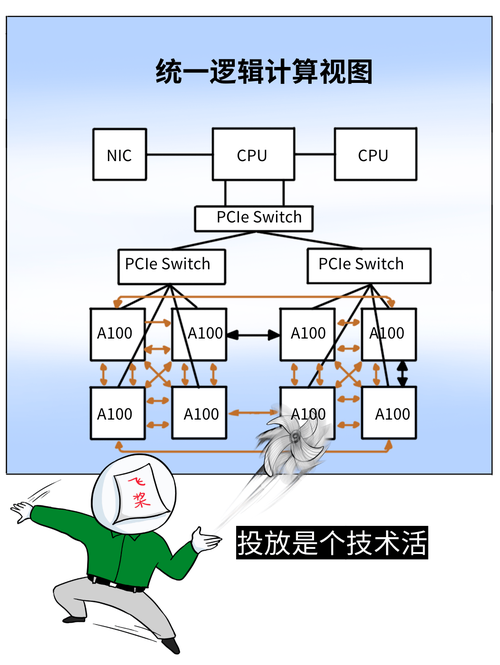

训练过程分为预训练与微调两个阶段,预训练阶段通过海量通用数据让模型掌握基础语言规律,采用掩码语言建模等技术,让模型学习预测被遮蔽的词语,这个过程需要数千块GPU或TPU进行并行计算,持续数周甚至数月,微调阶段则针对特定应用场景,使用垂直领域数据进行定向优化,例如医疗问答系统会补充专业医学文献数据。

优化调整是提升模型性能的关键环节,通过调整学习率、批处理大小等超参数,工程师能显著改善训练效率,引入对抗训练方法可增强模型的抗干扰能力,使其在遇到非常规输入时仍能保持稳定输出,评估环节采用困惑度、准确率、F1值等指标进行多维测评,同时组织人工评测确保生成内容符合实际需求。

训练过程中需要应对多个技术挑战,数据偏差可能导致模型输出带有倾向性,需通过平衡采样与去偏算法进行修正,计算资源消耗问题推动着分布式训练技术的发展,参数服务器架构与混合精度计算成为行业标配,知识更新难题催生出持续学习机制,使模型能动态吸收新信息而不遗忘已有知识。

实际应用中,语言模型已渗透到多个领域,在客服场景中,经过专业话术训练的模型能准确理解用户意图;教育领域通过知识点强化训练,模型可生成针对性辅导内容;法律行业借助案例库微调,模型能辅助起草专业文书,这些应用都建立在精准的训练策略之上。

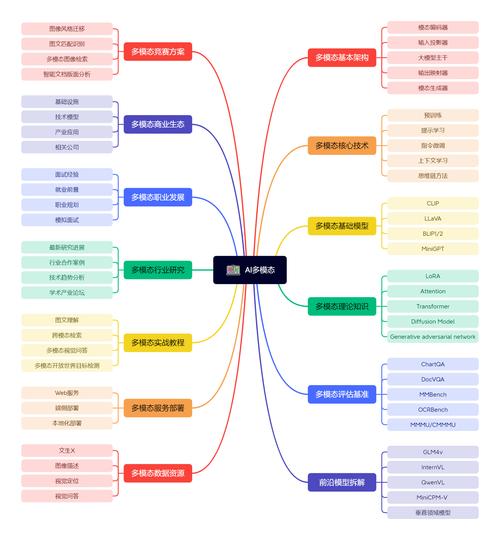

语言模型的进化速度远超预期,随着多模态训练技术的成熟,未来模型将融合文本、图像、语音等多维度信息,实现更接近人类认知的理解能力,但技术发展也带来伦理挑战,如何在创新与规范之间取得平衡,需要开发者保持审慎态度,训练优质语言模型既是技术工程,更是对社会责任的担当。