如何将AI模型真正“接入”你的图片?技术路径与实用指南

想象一下:上传一张普通的产品照片,AI瞬间为其添加符合品牌调性的精美背景;或是输入简单的文字描述,一张可用于网站封面的高清图片即刻生成,这并非科幻场景,而是当下AI图像技术赋予我们的真实能力,如何将强大的AI模型真正“接入”到你的图片处理流程中?关键在于理解不同的“接入”方式及其实现路径。

基础:让AI“看懂”你的图片(图像输入接入)

这通常是第一步,让AI模型接收并理解图片内容:

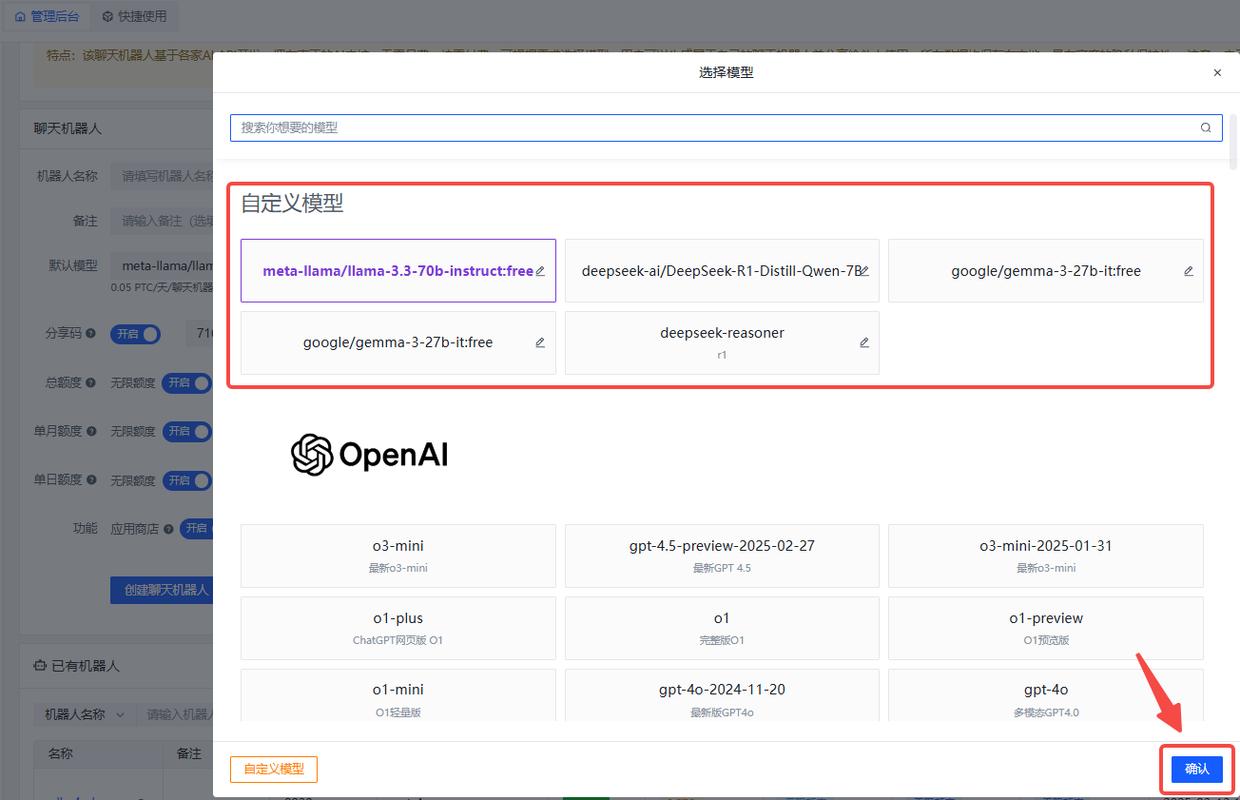

- API接口调用: 最主流方式,开发者通过代码调用云服务商(如百度智能云、阿里云、Google Cloud Vision、AWS Rekognition)提供的图像识别API,将图片文件或图片URL通过HTTP请求发送至API端点,即可返回识别结果(如物体、场景、文字、人脸信息)。

# 伪代码示例:调用图像标签识别API import requests api_url = "https://api.example.com/v1/image/analyze" api_key = "YOUR_API_KEY" headers = {"Authorization": f"Bearer {api_key}"} files = {"image": open("your_image.jpg", "rb")} response = requests.post(api_url, headers=headers, files=files) labels = response.json()["result"]["tags"] # 获取识别出的标签列表 - 预训练模型本地集成: 对于需要离线或深度定制的场景,可将开源的预训练模型(如PyTorch或TensorFlow Hub上的ResNet, YOLO, CLIP)集成到本地应用中,开发者加载模型,编写代码将图片数据转换为模型所需的张量格式输入,获取输出结果,这需要较强的机器学习工程能力。

- SDK集成: 部分平台提供软件开发工具包(SDK),封装了复杂的网络通信和数据处理,简化本地应用调用云端或本地模型的过程。

进阶:让AI“创造”或“改造”图片(图像生成与编辑接入)

这是目前最受关注的领域,主要涉及文生图、图生图、图像编辑增强:

- 生成式API调用:

- 文生图: 向如DALL·E 3 (OpenAI)、MidJourney(通过Discord bot或API)、Stable Diffusion API(如Stability AI平台)等发送文本提示(Prompt),直接生成全新图片,返回的通常是图片URL或二进制数据。

- 图生图: 提供参考图片+文本提示,生成基于原图的变体,上传人物照片并提示“商务正装照”,AI可生成换装效果;或上传草图生成精细效果图,API调用方式与文生图类似,需额外上传图片或提供图片URL。

- 图像编辑增强: 调用API实现智能抠图(如Remove.bg API)、超分辨率放大(腾讯云、阿里云等)、老照片修复、去噪、调色等,通常上传图片并指定任务参数即可。

- 开源模型本地部署与集成:

- Stable Diffusion: 最流行的开源方案,可在本地或自有服务器部署模型(需强大GPU支持),通过如

diffusers库(Python)或集成到ComfyUI等图形界面工具中运行,提供最大灵活性,可深度定制模型、插件(ControlNet, LoRA)和工作流,实现复杂图生图、精准控制生成效果。 - 本地运行工具: 如Fooocus(简化Stable Diffusion)、Draw Things(Mac/iOS)等,提供用户界面,降低了本地运行生成模型的门槛。

- Stable Diffusion: 最流行的开源方案,可在本地或自有服务器部署模型(需强大GPU支持),通过如

- 创意设计插件集成: Adobe Firefly直接集成在Photoshop中,Canva、Figma等设计平台也内置AI图像生成和编辑工具,用户通过软件界面直接操作,无需关心底层API调用。

关键考量因素与最佳实践

将AI接入图片工作流时,需深思熟虑:

- 需求明确: 核心是识别分析、内容生成还是图像优化?对生成结果的精确控制要求有多高?

- 技术能力评估: 团队是否具备API集成、模型微调或本地部署的能力?云API最快捷,本地部署最灵活但成本高。

- 成本效益: 云API按量计费(生成次数/处理时长),需预估用量;本地部署需硬件(GPU)投入和运维成本,开源模型免费但计算资源消耗大。

- 数据隐私与安全: 敏感图片上传至公有云API存在风险,需评估服务商隐私条款,金融、医疗等高度敏感场景,本地部署或私有化方案更安全。

- 效果与质量控制:

- Prompt工程: 生成质量极度依赖提示词,需学习撰写清晰、具体、包含风格和构图细节的提示词,迭代优化是常态。

- 参数调优: 本地部署Stable Diffusion时,需调整采样器、步数、CFG值等参数以获得最佳效果。

- 人工审核: 必须建立审核流程,检查生成内容的准确性、合规性(避免侵权、有害内容)。

- 伦理与版权: 清晰了解所用模型训练数据的版权状态及生成内容的版权归属(不同平台规则各异),避免直接生成受版权保护的特定艺术家风格或真人肖像,使用生成内容需谨慎,标明来源。

- 工作流整合: 如何将AI工具无缝嵌入现有图片生产、管理流程?可能需要定制开发中间件或自动化脚本(如Python)。

实战场景举例

- 电商: API调用实现商品图自动抠图、背景替换(纯色/场景)、生成模特图(虚拟试穿)、基于文字描述快速生成广告素材图。

- 媒体与营销: 利用文生图API快速制作文章配图、社交媒体海报;使用图生图基于现有素材生成系列延展图;智能修复历史图片素材。

- 设计创意: 设计师在Photoshop中使用Firefly扩展创意;利用本地Stable Diffusion+ControlNet精准生成符合线稿和构图的方案效果图。

- 应用开发: 在APP中集成人脸识别API(登录/美颜)、图像标签API(智能相册分类)、或内置AI头像生成功能。

未来展望:模型小型化、多模态融合与实时交互

接入AI处理图像正变得更便捷高效,轻量化模型在移动端部署成为可能,多模态大模型(能同时理解图、文、语音)让“以图搜图”、“图文互生”更精准,实时生成与编辑(如视频流AI滤镜)也在快速发展。

AI模型接入图片并非神秘的黑匣子操作,本质是选择适合的技术路径——便捷的云端API、灵活的开源部署或现成的设计工具——并将其可靠地整合进工作流程。 理解不同方式的优缺点,关注数据、伦理与效果控制,才能真正驾驭这股力量,让图片内容的生产与优化迈入智能新时代,技术的价值,最终在于使用者如何负责任且创造性地应用它。