在人工智能技术快速发展的今天,AI分类模型已成为许多行业实现自动化和智能化的核心工具,面对众多模型,如何科学合理地评估和排序,成为许多技术决策者和开发者关注的焦点。

评估一个AI分类模型的优劣,不能仅凭单一指标,而需从多个维度综合考量,模型的性能表现是首要因素,准确率、精确率、召回率和F1分数是衡量分类模型性能的经典指标,准确率反映模型整体预测正确的比例,但在数据分布不平衡时可能产生误导,精确率和召回率能更细致地评估模型在不同类别上的表现,而F1分数作为两者的调和平均数,提供了综合视角,AUC-ROC曲线也是评估模型区分正负样本能力的重要工具。

除了性能,模型的效率同样关键,效率涵盖训练效率和推理效率两方面,训练效率指模型从数据中学习到有效模式所需的时间和计算资源,某些模型虽然最终性能优异,但训练过程耗时过长,成本高昂,这在实践中可能难以承受,推理效率则关注模型部署后处理新数据的速度和资源消耗,直接影响用户体验和系统运行成本,参数量、计算复杂度和实际推理延迟是常用衡量标准。

泛化能力是另一重要考量维度,优秀的分类模型不仅要在训练数据上表现良好,更需对未见过的数据保持稳定预测能力,过度拟合训练数据细节而未能捕捉到普遍规律的模型,在实际应用中往往表现不佳,交叉验证、保留测试集和对抗样本测试是常用评估方法。

模型的可解释性日益受到重视,随着AI技术应用于医疗、金融、司法等高风险领域,人们不仅需要模型做出准确预测,更需理解其决策依据,具备可解释性的模型有助于开发者识别偏差、调试改进,也帮助用户建立信任,某些场景下,可解释性的价值甚至超过小幅性能提升。

资源的可获得性和易用性对模型选择具有实际影响,包括预训练模型的获取难度、所需训练数据量、框架支持程度、社区活跃度及文档完整性等,一个性能略逊但易于部署和调试的模型,往往比难以驾驭的尖端模型更具实用价值。

技术的适应性也不容忽视,优秀的分类模型应能较好适应不同任务领域和数据特征,某些模型为特定任务设计,在其他场景可能效果不佳,而像Transformer等架构因其强大适应性,在多个领域取得显著成功。

生态支持同样关系到模型的长期生命力,强大的开源社区、持续更新维护、丰富教程案例,都能降低使用门槛,加速问题解决,促进模型发展。

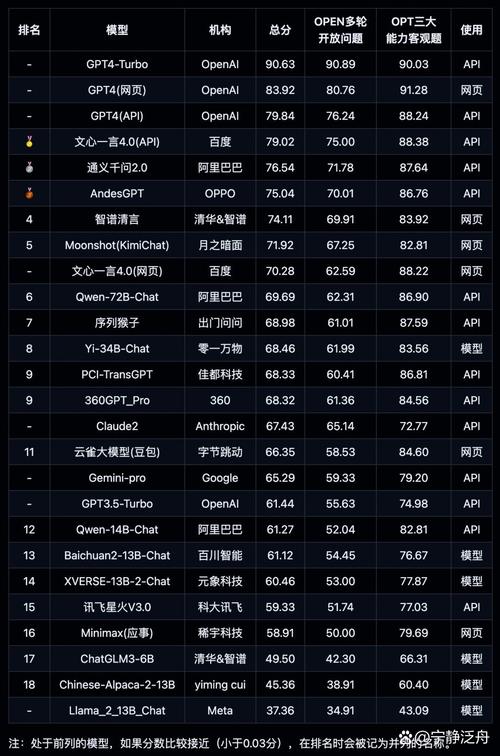

值得注意的是,模型排名并非静态,人工智能领域发展日新月异,新的模型、优化技术和训练方法不断涌现,去年领先的模型,今年可能已被超越,关注最新研究进展和技术动态至关重要。

在实际应用中,不存在“绝对最优”的分类模型,最适合的模型取决于具体任务需求、可用资源、技术约束和业务目标,图像分类任务的首选可能不适合文本情感分析,对延迟极其敏感的边缘计算场景与数据中心服务器的选择标准截然不同。

面对众多AI分类模型,明智的做法是明确自身需求优先级,深入理解各评估维度的含义,通过实验验证不同模型在特定任务和数据上的表现,从而做出科学决策,模型排名可作为有用参考,但最终选择应建立在全面评估和实际测试基础上,人工智能的价值在于解决现实问题,而非追逐排行榜上的数字。