随着人工智能技术的普及,许多开发者和技术爱好者开始探索如何独立部署AI模型,自己部署模型不仅能更好地控制应用场景,还能根据业务需求灵活调整,本文将一步步引导您完成AI模型的自主部署过程,涵盖从环境准备到上线运维的关键环节。

理解AI模型部署的核心

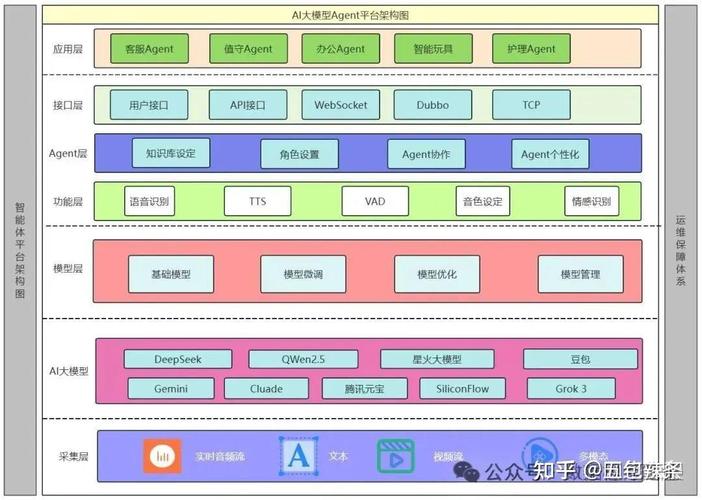

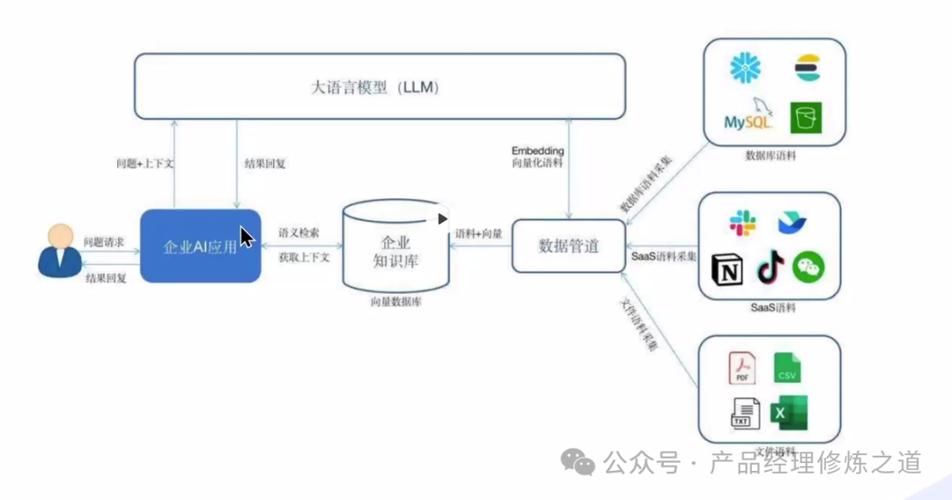

AI模型部署指的是将训练好的机器学习或深度学习模型集成到生产环境中,使其能够处理实时数据并提供预测服务,这个过程涉及多个层面,包括硬件配置、软件框架选择以及性能优化,部署成功后,模型可以应用于网站、移动应用或物联网设备中,实现智能决策功能。

部署前,您需要明确目标:是用于图像识别、自然语言处理还是预测分析?不同的模型类型会影响部署方式,卷积神经网络(CNN)常用于图像任务,而Transformer模型更适合文本处理,了解模型特性有助于选择高效的部署工具。

部署步骤详解

第一步:选择适合的模型 在部署前,确保模型已经训练完毕并保存为通用格式,如TensorFlow的SavedModel、PyTorch的TorchScript或ONNX格式,如果您使用预训练模型,可以从开源平台如Hugging Face或TensorFlow Hub下载,选择模型时,考虑其大小和复杂度:轻量级模型适合资源受限的环境,而大型模型可能需要分布式计算支持。

第二步:准备部署环境 环境准备是部署的基础,您可以选择本地服务器、云平台(如AWS、Google Cloud或阿里云)或边缘设备,硬件方面,GPU通常能加速推理过程,但CPU也可用于轻量级任务,软件环境包括安装必要的库和框架,例如TensorFlow、PyTorch或Scikit-learn,建议使用虚拟环境(如Conda或Docker)来隔离依赖,避免版本冲突。

对于云部署,许多平台提供AI专用服务,例如AWS SageMaker或Google AI Platform,这些工具简化了部署流程,但如果您希望完全自主控制,可以配置自有服务器,确保系统具备足够的存储和内存。

第三步:使用部署工具和框架 现代部署工具能大幅提升效率,Docker容器化是一个流行选择,它将模型和依赖打包成镜像,实现跨平台部署,Kubernetes可用于管理多个容器,确保高可用性和自动扩缩容。

专用服务框架如TensorFlow Serving或Triton Inference Server能优化模型推理性能,这些工具支持多模型版本管理和负载均衡,使用TensorFlow Serving时,您只需将SavedModel放入指定目录,服务会自动加载并提供REST或gRPC接口。

第四步:配置和优化模型 部署后,模型需进行配置以确保稳定运行,设置API端点供外部调用,并添加身份验证机制(如OAuth或API密钥)来保障安全,性能优化包括调整批处理大小、启用量化(减少模型大小)或使用硬件加速器(如TensorRT)。

监控是重要环节:集成日志系统(如Prometheus或ELK Stack)来跟踪模型准确率、响应时间和资源使用情况,如果性能下降,可能需要重新训练或调整超参数。

第五步:测试和上线 在正式上线前,进行全面测试,使用模拟数据验证模型的准确性和延迟,确保它在高负载下不会崩溃,A/B测试可用于比较不同版本的模型效果,上线后,定期更新模型以适配数据变化,并设置回滚机制应对意外问题。

常见挑战与应对策略

部署过程中,可能遇到资源不足、兼容性问题或安全漏洞,模型在训练环境表现良好,但在生产环境中因数据分布变化而失效,解决方法包括使用数据增强技术或实施持续监控。

另一个挑战是维护成本:自主部署需要技术团队投入时间运维,如果您资源有限,可以考虑混合方案,例如使用云服务的托管功能,同时保留核心控制权。

个人观点

在我看来,自主部署AI模型是一项值得投资的技能,它不仅加深了对AI系统的理解,还能在快速变化的技术环境中保持竞争力,初学者可以从简单项目起步,例如部署一个图像分类模型,逐步扩展到复杂场景,实践是最好的老师——通过动手尝试,您会发现部署过程中的问题往往能激发创新解决方案,如果您在途中遇到困难,不妨参考开源社区的案例,或与其他开发者交流经验,成功部署模型带来的成就感,将推动您在AI领域走得更远。