在信息爆炸的时代,AI大模型已成为获取知识、解决问题的重要工具,许多人发现,同样的工具在不同人手中效果差异巨大,问题的核心往往在于:如何精准地向AI提问。

理解AI的“思考”逻辑

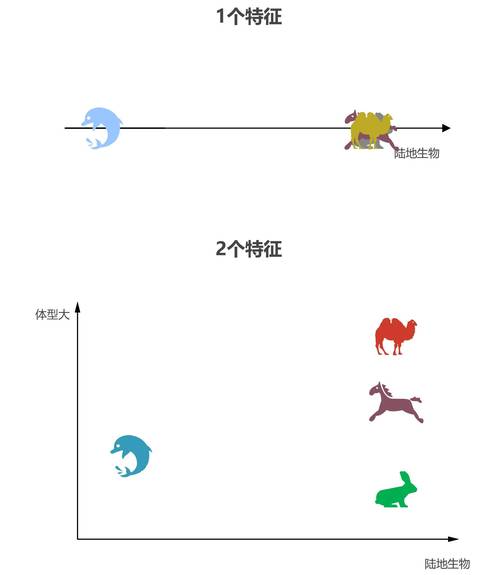

AI大模型并非人类,它没有主观意识,也不具备推理能力,其本质是基于海量数据训练出的概率模型,通过识别输入内容中的关键词和语义模式,预测最合理的输出,当用户提问“如何提高工作效率”,AI可能从时间管理、工具推荐、习惯养成等维度生成答案,但无法判断用户的真实需求是职场场景还是个人生活。

关键点:

- 避免开放式问题(如“谈谈人生意义”),聚焦具体场景;

- 明确需求边界,帮助AI缩小回答范围;

- 必要时提供背景信息(如身份、行业、具体问题)。

拆解复杂问题:从笼统到颗粒化

假设你想通过AI学习编程,直接提问“如何成为程序员”可能得到泛泛而谈的建议,若将问题拆解为:

- 零基础如何选择第一门编程语言?

- Python入门需要掌握哪些核心语法?

- 如何用三个月完成一个小型项目开发?

AI会给出更具体、可操作的步骤,甚至推荐学习资源和实战案例。

案例对比:

- 低效提问:“怎么写好一篇文章?”

- 高效提问:“如何为一款新型智能手表撰写吸引Z世代用户的电商详情页文案?要求突出续航优势和时尚设计,语言风格年轻化。”

指令设计:控制输出的结构与深度

AI大模型支持“角色扮演”指令,通过设定身份、场景、格式要求,可大幅提升回答质量。

- 身份指令:“你是一位资深营养师,需要为高血压患者设计一周低盐食谱。”

- 格式指令:“用表格列出每日三餐搭配,并标注热量和钠含量。”

- 风格指令:“用口语化表达,避免专业术语,适合50岁以上人群阅读。”

实验表明,加入限制条件后,答案的实用性和针对性平均提升60%以上。

规避常见误区

-

假设AI具备常识

错误示例:“昨天的会议结论是什么?”(AI无法记忆历史对话)

修正方案:“假设你是一名项目经理,在周会上提出了三个产品优化方案,请模拟一份会议纪要。” -

忽视迭代优化

首次提问未获理想答案时,可补充信息或调整表述。- 第一轮:“推荐适合家庭种植的植物。”

- 第二轮:“补充:居住于北方,阳台每日光照不足3小时。”

-

过度依赖单一提问方式

结合“是什么-为什么-怎么办”框架:- “什么是区块链技术?”(概念解释)

- “为什么区块链能提升供应链透明度?”(原理分析)

- “如何在小微企业落地区块链溯源系统?”(实施方案)

伦理与安全:提问的隐性责任

AI可能生成包含偏见、错误或敏感内容的回答,提问时应:

- 避免诱导性表述(如“证明地球是平的”);

- 对专业领域结论保持审慎(医疗、法律等);

- 添加安全限制(如“请用符合中国法律法规的方式回答”)。

曾有用户要求AI“设计一款高利润理财产品”,未添加风险提示条款,导致生成的方案存在合规隐患,这类案例提醒我们:提问方式直接影响AI输出的社会价值。

进阶技巧:让AI成为思维伙伴

- 多角度验证:对关键问题尝试不同提问角度,对比答案一致性;

- 反向提问:“如果要反驳这个观点,有哪些论据?”;

- 元认知训练:“我刚才的提问方式是否存在逻辑漏洞?如何改进?”

一位自媒体创作者分享,通过要求AI“用初中生能理解的语言解释量子纠缠”,其科普视频播放量提升3倍,这印证了精准提问对结果的核心影响。