AI声音模型是近年来人工智能技术发展的重要成果之一,它通过深度学习算法模拟人类语音,广泛应用于语音合成、虚拟助手、有声读物制作等领域,对于普通用户或创作者来说,掌握AI声音模型的使用方法,可以大大提升工作效率和创意表达,本文将详细介绍如何有效利用AI声音模型,从基础操作到高级应用,帮助您快速上手。

了解AI声音模型的基本原理是使用的第一步,这类模型通常基于神经网络训练,能够分析文本输入并生成自然流畅的语音输出,常见的类型包括文本转语音(TTS)模型和语音克隆模型,前者将文字转换为语音,后者则可以模仿特定人的声音,在选择模型时,您需要考虑自己的需求:如果是简单的语音播报,通用TTS工具如Google的WaveNet或Amazon Polly就足够;如果需要个性化声音,则可能需要更专业的平台如Descript或Respeecher。

开始使用AI声音模型前,您需要准备合适的工具和环境,大多数AI声音模型以云端服务或软件应用的形式提供,用户无需深厚的编程知识即可操作,许多在线平台提供免费试用,您只需注册账户,上传文本或音频样本,即可生成语音,对于开发者,还可以通过API接口集成到自己的应用中,建议先从用户友好的工具入手,比如使用手机App或网页端服务,这能降低入门门槛。

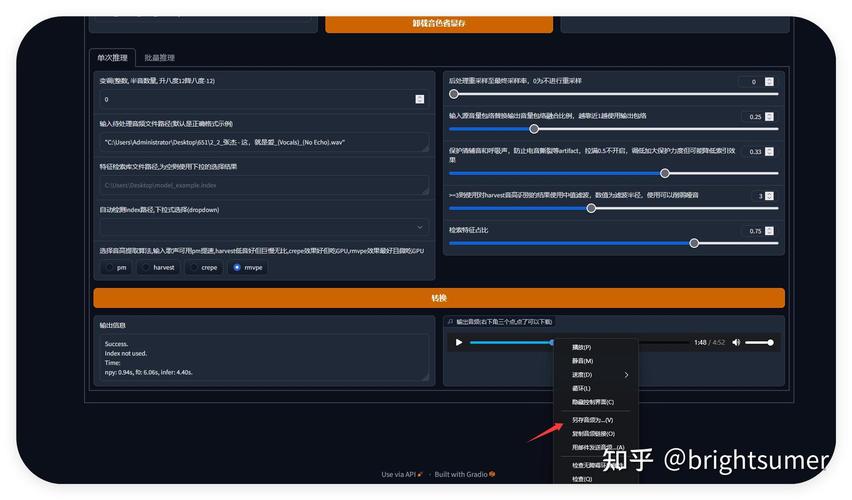

接下来是实际操作步骤,第一步是输入文本内容,确保文本清晰、无语法错误,这对生成高质量的语音至关重要,如果用于商业或教育场景,可以提前校对文字,避免歧义,第二步是选择声音参数,AI声音模型通常允许调整音色、语速、音调和情感表达,您可以选择男声或女声,设置欢快或严肃的语气,以适应不同场景如播客、视频配音或客服系统,第三步是生成和预览语音,大多数工具提供实时试听功能,让您检查效果,如果不满易,可以反复调整参数直至满意。

在使用过程中,注意数据隐私和版权问题,AI声音模型可能涉及用户数据的处理,尤其是语音克隆技术,需要确保您拥有合法授权的声音样本,生成的内容应遵守相关法律法规,避免侵犯他人权益,模型性能受硬件和网络影响,如果处理大量数据,建议使用高性能设备或云服务器以保证流畅度。

为了提升使用效果,可以结合其他工具进行优化,将AI生成的语音导入音频编辑软件如Audacity,进行降噪或混音处理;或者与视频制作软件配合,创建多媒体内容,实践表明,多次试用不同模型能帮助您找到最适合自己需求的方案,一些用户反馈,在制作教育视频时,使用情感丰富的AI声音能增强学习体验;而在商业演示中,清晰专业的语音更受欢迎。

从个人经验来看,AI声音模型的普及正在改变传统内容创作方式,它不仅节省了时间和成本,还为残障人士提供了便利,比如视障用户可以通过语音合成访问文字信息,技术并非完美,当前模型在模拟复杂情感或方言时仍有局限,随着算法进步,我们可以期待更智能、自然的语音交互,建议用户保持学习心态,关注行业动态,以充分利用这一工具。

AI声音模型的使用是一个逐步探索的过程,通过选择合适的工具、细心调整参数,并注重实际应用,您能轻松将其融入日常生活或工作中,实践出真知,多尝试不同场景会让您更熟练地驾驭这项技术。