AI模型是如何创作内容的?揭秘人机协作的创作新范式

当读者在屏幕上看到一行行流畅的文字时,或许会想象AI模型如同人类作家般"奋笔疾书",但现实中的创作过程远非如此简单直观——它是一场精密的数据风暴与算法共舞的结果。

核心驱动力:海量数据与模式识别 AI模型的创作能力并非凭空而来,它的根基深植于浩瀚的文本海洋中,通过分析数以亿计的网页、书籍、论文与对话记录,模型逐渐掌握了人类语言的复杂规律:

- 词汇关联: 学会"咖啡"常与"早晨""提神""香气"相伴出现

- 语法结构: 理解主谓宾的基本框架和复杂从句的嵌套逻辑

- 风格特征: 区分新闻的客观严谨与社交媒体的轻松随意

- 知识图谱: 构建概念间的联系(如"光合作用"必然关联"植物""阳光")

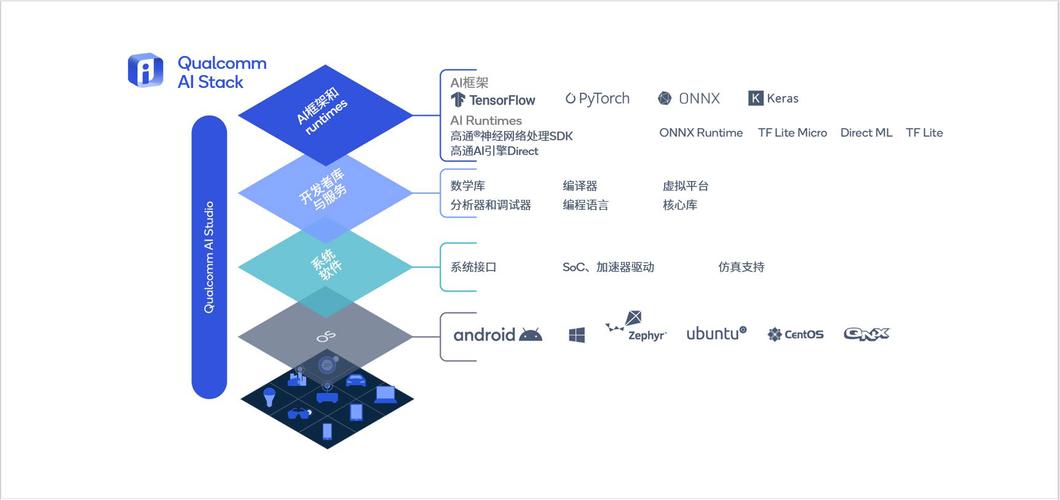

这种学习依赖强大的神经网络架构(如Transformer),当模型接收到你的提示时,它并非回忆句子,而是根据概率预测最可能跟随的下一个词,逐字生成响应——就像超高阶的"智能联想输入"。

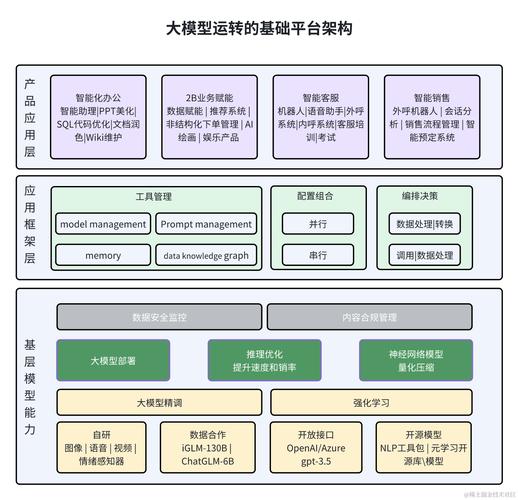

创作过程:人机交互的精密协作 一篇AI文章的诞生,往往经历多阶段协作:

- 意图解码: 模型首先解析用户提示的深层需求,当用户要求"用通俗语言解释量子纠缠",模型需避开深奥术语,选择生活化比喻。

- 信息检索: 激活训练数据中的相关知识模块,确保概念准确性。

- 结构规划: 依据文体惯例构建框架(如议论文的"论点-论据-)。

- 逐词生成: 基于概率选择每个后续词汇,同时保持上下文连贯。

- 优化调整: 高级模型会进行多轮自我审查,修正矛盾或模糊表达。

例如生成产品描述时,模型会提取训练数据中同类文案的卖点聚焦模式、情感词汇分布,再结合当前产品的参数生成新文本。

关键角色:人类引导与模型优化 AI的创作高度依赖人类的智慧引导:

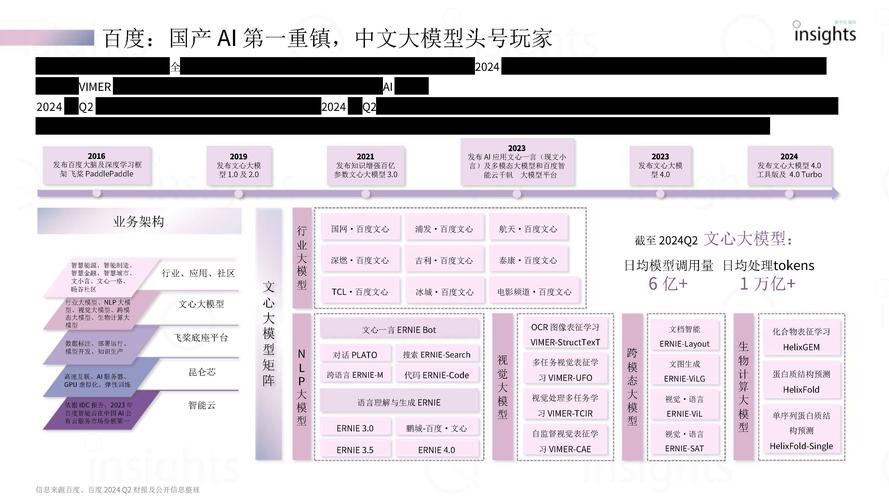

- 训练监督: 工程师通过标注数据、设计奖惩机制(如RLHF技术),教会模型区分优质与低质内容,OpenAI在GPT-4训练中使用了大量人类编写的示范和偏好数据。

- 提示工程: 用户的具体要求(如"列出三点优势,每点不超过15字")直接框定输出形式,模糊的提示往往导致泛泛而谈。

- 结果修正: 生成内容需经过人工审核调整,某科技媒体编辑使用AI初稿后,会重写30%内容以强化观点深度。

能力边界:创新与深度的挑战 当前AI创作存在明显局限:

- 事实性偏差: 可能混合不同来源信息产生"幻觉",如将两个相似事件细节错误拼接。

- 深度创新不足: 擅长重组已知信息,但难以提出颠覆性理论,它无法像人类学者一样提出全新哲学框架。

- 情感表达局限: 能模仿情感词汇,但缺乏真实体验支撑,生成的悼词可能语法完美却难以动人。

未来方向:工具化与专业化 AI写作的本质是高级信息处理工具,它的核心价值在于:

- 效率提升: 快速生成初稿、摘要或数据报告

- 知识辅助: 提供背景资料支持人类决策

- 创意激发: 通过非常规词组合碰撞出新想法

随着多模态模型发展,AI创作将向更专业化迈进,法律AI可精准生成合规文书,医疗AI能撰写患者易懂的病理说明——在垂直领域深度训练的专业模型,其输出质量与可靠性将显著超越通用工具。

当文字在指尖流淌,我们看到的不仅是代码的运算结果,更是人类集体智慧与算法力量的交织,与其担忧替代,不如专注驾驭——在可见的未来,深度思考与真实洞察,依然是创作者不可替代的灵魂。