在当今快速发展的技术领域,人工智能已经深入到各个工程应用中,从自动化设计到预测分析,都离不开高效的模型导入流程,作为网站站长,我经常收到访客询问如何将AI工程模型导入到他们的项目中,这个过程看似简单,但涉及多个关键步骤,需要结合专业知识和实践经验,我就来详细聊聊这个话题,帮助大家避免常见误区,提升工作效率。

我们需要明确什么是AI工程模型,它是指经过训练和优化的机器学习或深度学习模型,用于解决特定工程问题,比如图像识别、自然语言处理或预测维护,这些模型通常以文件形式保存,例如TensorFlow的SavedModel、PyTorch的.pth文件,或者ONNX格式,导入这些模型意味着将它们加载到运行环境中,以便进行推理或进一步调整。

导入AI工程模型的第一步是准备环境,这包括安装必要的软件库和框架,如果您使用Python,可能需要TensorFlow、PyTorch或Scikit-learn,确保您的开发环境与模型兼容至关重要,一个用TensorFlow 2.x训练的模型可能无法在旧版本中正常运行,我建议先检查文档,确认依赖项和版本要求,设置虚拟环境可以避免库冲突,这是一个专业工程师常用的做法。

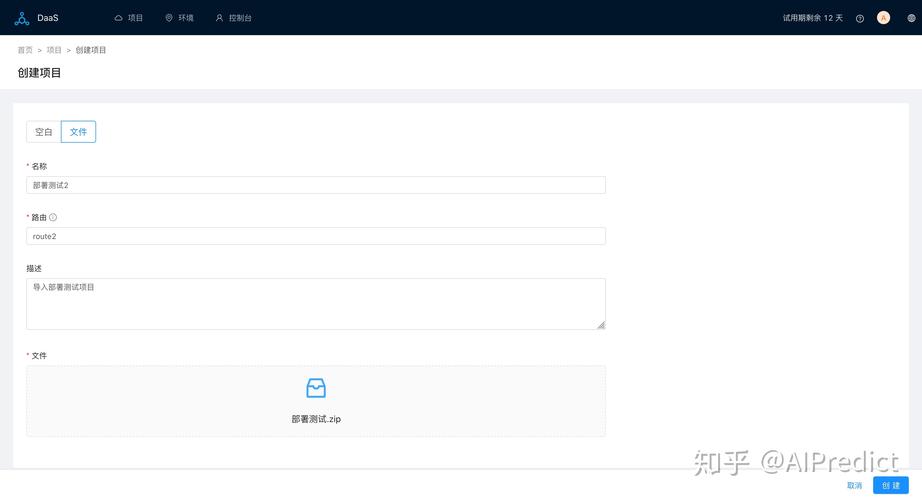

接下来是模型文件的处理,模型可能以多种格式存储,如HDF5(.h5)、Pickle(.pkl)或JSON,在导入前,验证文件完整性和安全性很重要,使用哈希校验或数字签名来防止损坏或恶意篡改,对于大型模型,考虑使用云存储或分布式系统来优化加载时间,在实际操作中,您可以通过代码命令加载模型,以TensorFlow为例,使用tf.keras.models.load_model()函数即可导入SavedModel格式的模型,如果是PyTorch,则用torch.load()加载状态字典,再应用到模型结构中。

导入过程中,数据预处理是关键环节,模型通常需要特定格式的输入数据,比如归一化的数值或特定尺寸的图像,如果忽略这一步,可能导致预测错误或性能下降,在导入一个图像分类模型时,您可能需要将输入图像调整为模型训练时使用的分辨率,并进行标准化处理,这体现了专业工程中的细节把控,能显著提升模型应用的准确性。

另一个重要方面是模型验证,导入后,务必测试模型性能,确保它在新环境中正常运行,这包括运行示例数据检查输出、评估准确率或计算推理时间,如果模型涉及实时应用,还需考虑延迟和资源占用,通过单元测试或集成测试,您可以及早发现问题,避免在部署阶段出现意外。

兼容性问题也是导入模型时常见的挑战,不同框架或硬件平台可能对模型支持有限,一个在GPU上训练的模型可能需要在CPU上调整才能运行,这时,转换工具如ONNX Runtime或TensorFlow Lite能帮助跨平台部署,关注社区更新和最佳实践,能让您跟上技术演进,减少兼容性风险。

从安全角度,导入模型时需警惕潜在风险,模型文件可能包含敏感信息或漏洞,因此建议从可信来源获取,并定期进行安全扫描,在企业级应用中,结合权限管理和加密措施,能进一步保障数据隐私。

在我看来,掌握AI模型导入技能不仅是技术需求,更是提升工程效率的核心,随着AI工具不断进化,这个过程会变得更加自动化,但基础原理和谨慎态度永远不可或缺,通过实践和持续学习,您可以将模型导入转化为项目成功的助推器,而不是瓶颈,希望这些分享能为您提供实用指导,助力您在AI领域走得更远。