在当今技术快速发展的时代,开源AI模型已经成为许多开发者和企业的重要工具,这些模型提供了强大的基础能力,但实际应用中,往往需要根据特定需求进行修改和优化,修改开源AI模型不仅能提升性能,还能适应个性化的场景,比如图像识别、自然语言处理或预测分析,下面,我将详细介绍修改开源AI模型的基本步骤和注意事项,帮助您更好地理解和应用这一过程。

修改开源AI模型需要从理解模型的结构开始,大多数开源模型,如基于Transformer的模型或卷积神经网络,都提供了详细的文档和代码库,您需要仔细阅读这些资料,了解模型的输入输出格式、层结构以及训练参数,如果您使用像BERT或GPT这样的预训练模型,可以通过查看其配置文件(如JSON或YAML文件)来掌握关键组件,这一步至关重要,因为错误的修改可能导致模型失效或性能下降,建议先从简单的调整入手,比如修改输出层的节点数以适应分类任务中的类别数量。

数据准备是修改模型的核心环节,开源模型通常是在通用数据集上训练的,而您的应用场景可能需要特定的数据,收集和预处理数据是必不可少的,数据预处理包括清洗、标注和增强,以确保数据质量,在图像识别任务中,您可以通过旋转、裁剪或调整亮度来增加数据多样性,确保数据格式与模型输入兼容,比如将图像转换为特定尺寸或文本转换为词向量,数据质量直接影响模型修改的效果,因此投入时间在这一步往往能带来显著的回报。

进入模型微调阶段,微调是指在预训练模型的基础上,使用您的数据集进行进一步训练,这可以通过调整学习率、优化器和损失函数来实现,在PyTorch或TensorFlow框架中,您可以加载预训练权重,然后冻结部分层(如底层特征提取器),只训练顶层以适应新任务,这种方法能节省计算资源,同时保持模型的泛化能力,需要注意的是,微调过程中要监控过拟合现象,可以通过交叉验证或早停法来避免,根据任务复杂度,您可能需要调整模型架构,比如添加或删除层,以提升效率。

工具和框架的选择也对修改过程有重要影响,流行的开源框架如Hugging Face的Transformers库或TensorFlow Hub提供了丰富的模型和接口,方便用户进行自定义修改,这些工具通常附带示例代码和社区支持,能加速开发流程,使用Hugging Face的管道功能,您可以快速加载模型并修改其配置参数,集成开发环境(IDE)如Jupyter Notebook或VS Code能帮助您调试代码,确保修改的准确性,选择适合的工具不仅能提高效率,还能降低技术门槛。

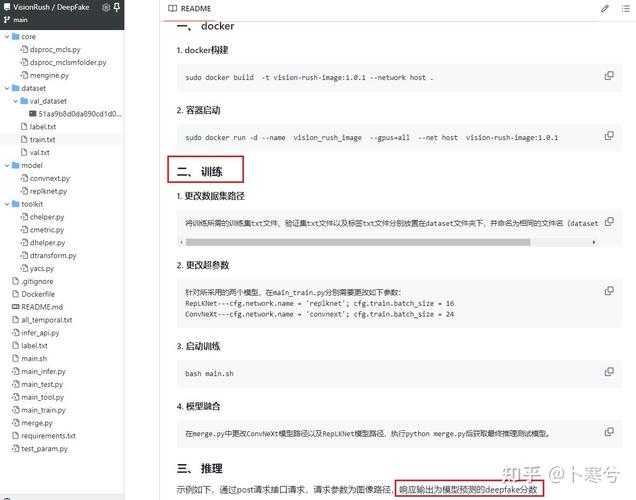

在修改过程中,测试和验证是不可或缺的步骤,完成微调后,您需要使用独立的测试集评估模型性能,指标如准确率、F1分数或混淆矩阵能反映修改效果,如果结果不理想,可以回溯到数据或架构调整阶段,进行迭代优化,考虑模型的可解释性,例如使用SHAP或LIME工具分析预测结果,这有助于发现潜在问题并提升可信度,部署修改后的模型时,确保其与生产环境兼容,比如通过容器化技术(如Docker)或云服务平台实现无缝集成。

我想强调,修改开源AI模型不仅是技术操作,更是一种创新实践,它能帮助您将通用工具转化为专属解决方案,推动业务增长或科研进步,通过逐步学习和实践,您可以掌握这一技能,并从中获得成就感,耐心和持续学习是关键,因为AI领域日新月异,保持更新才能跟上潮流,无论您是初学者还是经验丰富的开发者,这个过程都能为您打开新的可能性。