在当今技术快速发展的时代,训练个人AI模型已不再是科研机构或大型企业的专利,越来越多的开发者和技术爱好者开始尝试构建属于自己的智能模型,用于解决特定场景下的问题,无论是图像识别、自然语言处理,还是语音合成,个人AI模型的训练正逐渐走向普及,如何高效且系统地完成这一过程呢?

训练个人AI模型的第一步是明确任务目标与数据准备,一个清晰的定位能帮助后续工作更加聚焦,如果你希望训练一个能够识别特定花卉种类的图像分类模型,那么就需要收集大量相关花卉的图片,并确保每张图片都带有准确的标签,数据的质量直接决定了模型性能的上限,因此在这一环节需投入足够精力,数据应涵盖多样场景、光照条件和角度,避免偏差过于明显,数据标注务必准确一致,噪声过大的数据会严重影响模型收敛效果。

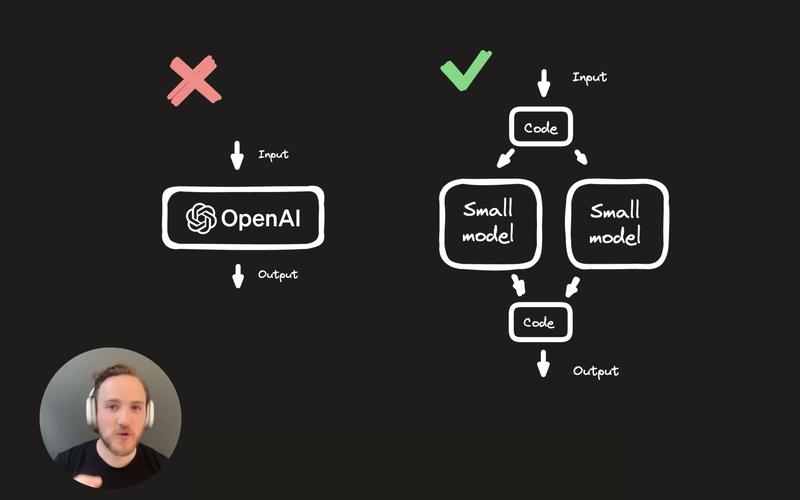

接下来是模型选择与架构设计,根据任务类型的不同,可以选择现成的预训练模型进行微调,也可以从零开始构建新模型,对于绝大多数个人开发者而言,基于预训练模型(如BERT、ResNet或GPT系列)进行迁移学习是更高效的方式,这不仅能大幅减少训练时间和计算资源消耗,还能在有限数据下达到较好效果,如果任务非常特殊或对模型结构有独特需求,也可以尝试自定义网络结构,但需注意模型的复杂度和训练成本之间的平衡。

训练过程中的关键环节是超参数调优与迭代优化,学习率、批次大小、训练轮数等参数都会显著影响模型性能,一般建议从小规模实验开始,逐步调整参数,并借助验证集评估模型表现,为了避免过拟合,可采用早停策略(early stopping)或引入正则化方法,使用可视化工具(如TensorBoard)监控训练过程,能更直观地把握模型状态。

模型训练完成后,还需进行全面的评估与测试,仅仅依靠准确率或损失函数可能不足以反映真实场景下的表现,建议使用多种指标(如精确率、召回率、F1分数等)进行多维度评估,并在测试集上验证模型的泛化能力,如果发现模型在某一类别上表现较差,可能需要回溯检查数据标注或考虑增加数据量。

将训练好的模型部署到实际环境中是检验其价值的最终步骤,可以选择本地部署,也可以借助云服务提供API接口,需要注意的是,模型部署后仍需持续监控其表现,并定期更新数据重新训练,以适应现实场景的变化。

整个个人AI模型的训练过程是一个循环迭代、不断优化的工程,它既需要严谨的方法论,也离不开实践中的灵活调整,正如许多开发者所体会到的,每一次训练不仅是技术的实践,更是对问题理解的深化,只有通过不断试错与反思,才能逐渐提升模型的智能水平与应用效果。