在数字化浪潮席卷各行各业的当下,人工智能模型已成为提升效率、创新服务的关键工具,对于许多开发者和企业技术负责人而言,将训练好的模型从实验环境部署到生产环境,使其能够稳定、高效地提供服务,是一个至关重要的环节,这个过程并非一蹴而就,它涉及一系列严谨的步骤与考量。

第一步:扎实的前期准备与环境配置

在启动部署之前,充分的准备工作是成功的基石,这包括对运行环境的细致规划,你需要选择一个合适的服务器环境,无论是本地物理服务器、私有云还是公有云平台(如阿里云、腾讯云、AWS等),操作系统的选择也需谨慎,Ubuntu Server或CentOS是常见且社区支持良好的选择。

接下来是环境依赖的配置,你的AI模型依赖于特定的运行环境,例如Python解释器、深度学习框架(如TensorFlow, PyTorch, PaddlePaddle),以及一系列第三方库(如NumPy, Pandas, OpenCV等),强烈建议使用虚拟环境工具(如Python的venv、conda)或容器化技术(如Docker)来隔离项目环境,这样做不仅能避免不同项目间的依赖冲突,还能确保环境的一致性,为后续的部署和迁移扫清障碍。

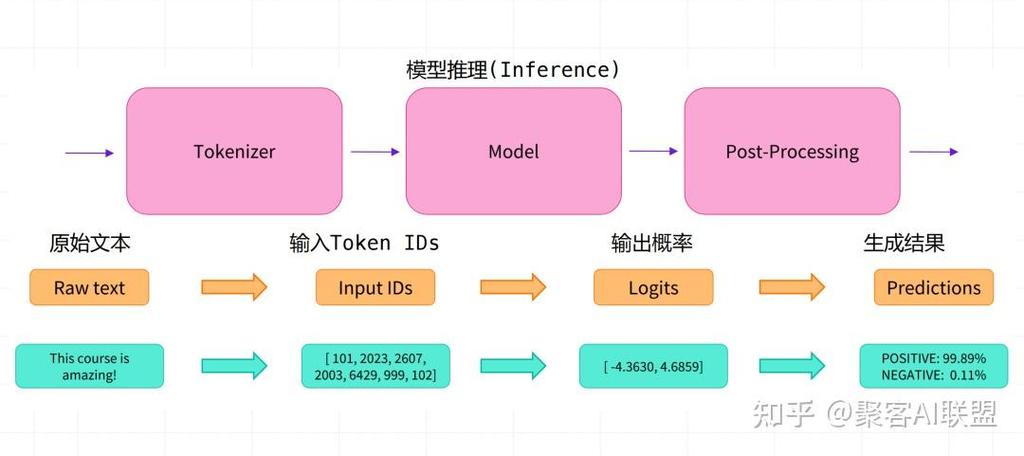

第二步:模型优化与格式转换

直接从训练框架保存的模型文件可能并非生产环境下的最优选择,为了提高部署后的推理速度和资源利用率,模型优化是不可或缺的一环。

- 序列化与格式转换:确保模型被正确序列化,对于PyTorch,这可能是

.pt或.pth文件;对于TensorFlow,可能是SavedModel格式或.h5文件,许多部署引擎需要特定的模型格式,ONNX(开放神经网络交换)格式作为一种中间表示,可以被多种推理引擎识别,是实现跨平台部署的利器,你还可以考虑使用各框架自带的优化工具,如TensorFlow Lite(用于移动和嵌入式设备)、TensorFlow Serving或PyTorch Mobile。 - 性能优化:根据你的硬件(特别是GPU,如NVIDIA系列),利用厂商提供的工具链进行优化是提升性能的关键,对于NVIDIA GPU,可以使用TensorRT对模型进行优化和加速,它能显著降低延迟、提高吞吐量。

第三步:选择合适的部署架构与工具

部署架构的选择直接影响服务的可扩展性、可靠性和维护成本,以下是几种主流方案:

- Web服务框架:对于中小型项目或快速原型,使用成熟的Web框架(如Python的FastAPI、Flask或Django)将模型封装成HTTP/RESTful API是一种简单直接的方式,这种方式开发速度快,可以方便地实现请求处理、日志记录和简单的身份验证。

- 专用模型服务化工具:对于要求高性能、高并发的生产环境,推荐使用专为模型部署设计的工具,TensorFlow Serving是服务TensorFlow模型的高性能系统;Triton Inference Server(由NVIDIA开发)则支持多种框架(TensorFlow, PyTorch, ONNX等)并在GPU上表现出色,具备动态批处理、模型并发等高级特性。

- 容器化与编排:无论选择哪种服务方式,将你的模型、依赖和应用程序一起打包成Docker镜像都是最佳实践,这保证了环境的高度一致性,随后,你可以使用Kubernetes这类容器编排工具来管理你的部署,它能够轻松实现应用的自动扩缩容、滚动更新和故障自愈,极大提升了系统的弹性与可维护性。

- 无服务器架构:对于流量波动大或间歇性任务的场景,可以考虑将模型部署在云厂商提供的无服务器函数计算服务上(如AWS Lambda,阿里云函数计算),你只需关注代码本身,无需管理服务器,平台会根据请求量自动伸缩。

第四步:确保性能、监控与安全

模型服务上线后,工作并未结束,持续的运维保障同样重要。

- 性能测试与优化:部署后,必须进行压力测试,评估服务在并发请求下的响应时间、吞吐量和资源消耗(CPU、内存、GPU利用率),根据测试结果,进一步调整模型、批处理大小或服务器配置。

- 完备的监控体系:建立全面的监控机制至关重要,这包括:

- 基础设施监控:跟踪服务器的CPU、内存、磁盘I/O和网络流量。

- 应用性能监控:记录API的请求量、响应延迟、错误率。

- 模型性能监控:对于监督学习模型,可能需要通过抽样等方式,持续监控其预测准确性或漂移情况,以便在模型性能下降时触发重新训练。

- 安全考量:公开的API接口必须考虑安全问题,实施必要的身份验证(如API Key、JWT令牌)和授权机制,防止未授权访问,对输入数据进行严格的验证和清洗,防范诸如恶意注入攻击等风险,确保服务的安全稳定。

持续迭代与维护

AI模型的部署是一个持续的过程,业务需求在变化,数据分布也可能随时间改变,你需要建立一套完整的MLOps流水线,自动化模型的重新训练、评估、部署和监控流程,这样能够确保线上模型始终保持最佳状态,快速响应业务需求的变化。

部署AI模型是一项融合了软件工程、运维知识和AI专业技能的综合性工作,从环境准备到架构选择,再到性能监控与安全加固,每一个环节都需要周密计划和细致执行,我个人建议,在项目初期可以根据团队技术储备和业务规模,从简单的Web API入手,再逐步演进到更健壮、可扩展的容器化与编排架构,关键在于开始实践,并在过程中不断学习和优化。