人工智能模型的部署是一个关键步骤,它将训练好的模型转化为实际应用,为用户提供智能服务,作为网站站长,我经常被问到如何高效地完成这一过程,我将分享一些实用的方法和见解,帮助你理解AI模型部署的核心环节。

部署AI模型前,首先需要确保模型已经过充分训练和验证,模型训练不仅仅是数据拟合,还包括评估其准确性、泛化能力和鲁棒性,在图像识别任务中,模型应在不同光照和角度下保持稳定表现,验证阶段使用测试数据集检查模型性能,避免过拟合或欠拟合问题,这一步骤至关重要,因为一个未经充分验证的模型在部署后可能导致服务中断或用户投诉。

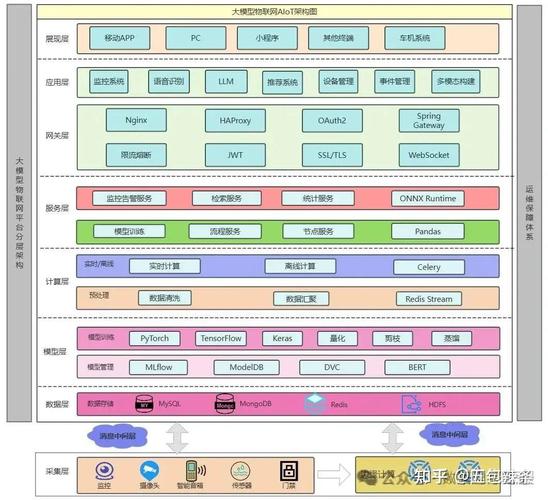

选择适合的部署环境是成功的关键,常见的部署方式包括本地部署、云部署和边缘部署,本地部署指在自有服务器上运行模型,适合数据敏感或网络不稳定的场景,但需要较高的硬件和维护成本,云部署则利用云服务提供商(如AWS或Google Cloud)的资源,具有弹性扩展和低成本优势,特别适合初创企业或快速迭代项目,边缘部署将模型部署在终端设备上,如智能手机或物联网设备,能够实现低延迟响应,但受限于设备计算能力,根据业务需求选择合适的环境,可以平衡性能、成本和安全性。

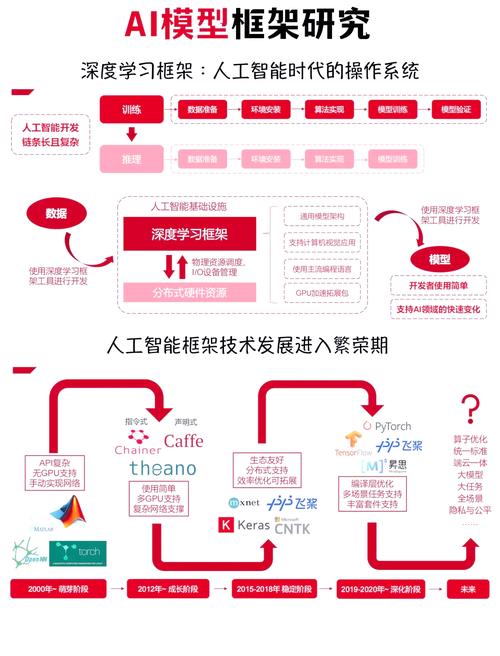

模型优化是部署过程中的重要环节,训练好的模型往往体积庞大,直接部署可能影响响应速度,通过技术如量化、剪枝或知识蒸馏,可以减少模型大小和计算需求,量化将浮点数权重转换为低精度格式,如8位整数,从而提升推理速度,剪枝移除模型中不重要的连接,降低复杂度而不显著影响精度,这些优化方法需要在保持模型性能的前提下进行,通常通过工具如TensorFlow Lite或ONNX实现,优化后的模型更易于在资源受限的环境中运行。

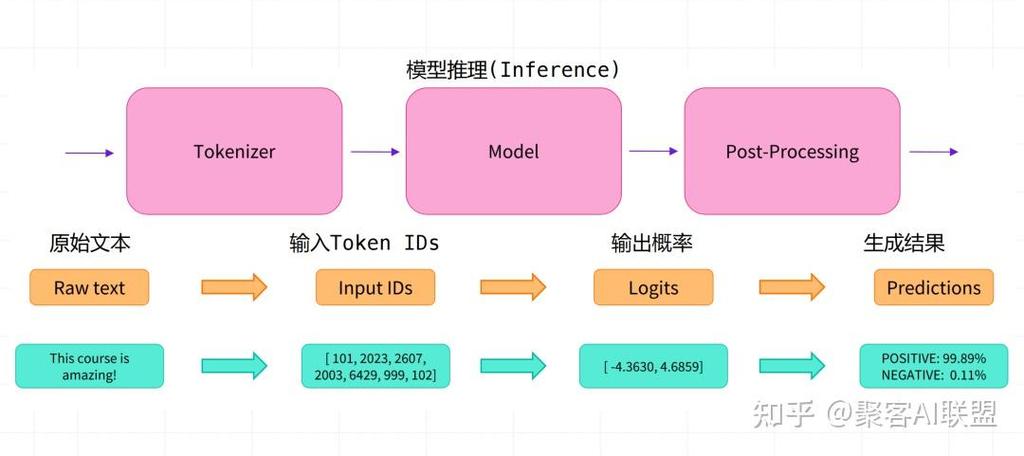

集成模型到实际应用是部署的核心步骤,这包括将模型封装为API服务或嵌入到现有系统中,使用RESTful API将模型暴露为网络接口,允许其他应用通过HTTP请求调用,在开发过程中,需考虑错误处理、日志记录和版本管理,确保服务可靠,与前端或移动端集成时,要保证数据格式兼容,如图像预处理符合模型输入要求,测试阶段包括单元测试、集成测试和压力测试,模拟高并发场景验证系统稳定性。

监控和维护是部署后不可忽视的部分,一旦模型上线,需要实时跟踪其性能指标,如响应时间、准确率和资源使用率,工具如Prometheus或Grafana可以帮助可视化这些数据,模型可能会因数据分布变化而出现性能下降,这种现象称为模型漂移,定期用新数据重新训练模型,或设置自动 retraining 流水线,可以维持服务品质,安全措施如加密传输和访问控制,能防止恶意攻击和数据泄露。

在实际操作中,部署AI模型可能遇到各种挑战,硬件兼容性问题可能导致模型无法在某些设备上运行,解决方法是使用跨平台框架或容器化技术,如Docker,将模型与环境隔离,另一个常见问题是延迟过高,影响用户体验,通过优化代码、使用CDN加速或选择就近的云区域,可以显著降低延迟,经验表明,提前规划这些细节能避免后期大量调整。

从个人角度看,AI模型部署不仅是技术实现,更是业务落地的桥梁,随着技术发展,部署工具越来越智能化,例如AutoML平台能自动化部分流程,但我认为,成功部署离不开团队协作和持续学习,开发者应关注行业动态,如联邦学习等新兴技术,它们可能在将来简化部署复杂度,目标是让AI服务无缝融入生活,为用户创造真实价值。